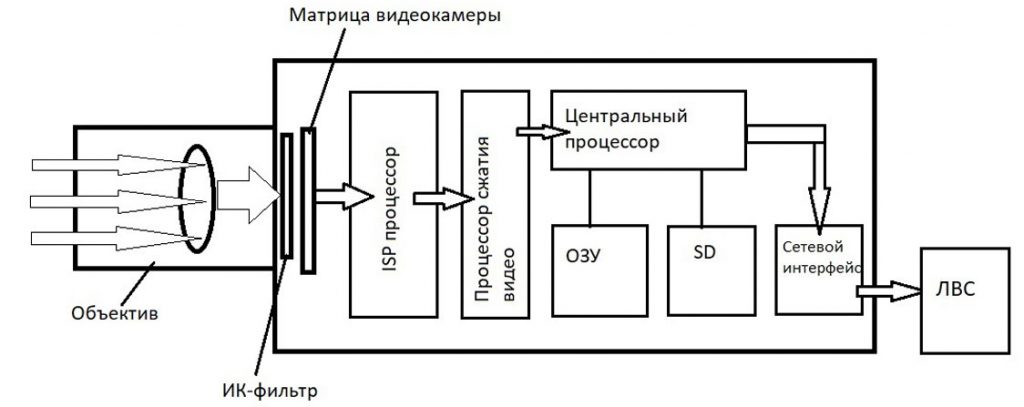

Задача процессора камеры — обработать сигнал, сформированный матрицей, сжать его кодеком и передать в линию связи, подключенную к камере.

Эволюция камер видеонаблюдения

В процессе эволюции камер наблюдения применялись (и применяются) различные типы процессоров и вычислительных платформ:

- DSP-процессор (Digital Signal Processors) — процессор цифровой обработки сигналов;

- FPGA (Field-Programmable Gate Array) — программируемая логическая интегральная схема (ПЛИС);

- ISP-процессор (Image Signal Processor) — процессор обработки изображений (специализированный DSP), может быть частью SoC;

- SoC-процессор (System On Chip) — центральный процессор (ЦП) — «мозг» камеры;

- SoM (System on Module) — готовая вычислительная платформа, может включать в себя SoC. SoM включает основные компоненты встроенной системы обработки, включая процессорные ядра, интерфейсы связи и блоки памяти, на одной готовой к производству печатной плате (PCB)

Принцип работы:

- На объектив камеры попадает изображение, которое усиливается благодаря светочувствительной линзе

- Усиленный сигнал передается на матрицу

- Световой поток преобразуется в электрический сигнал в ISP-процессоре

- Аналоговая информацией переводится в цифровые данные и передается в процессор сжатия видео

- Благодаря компрессионному блоку обеспечивается форматирование изображения или видео, готовится сетевая передача

- Сжатый видеосигнал выводится при помощи центрального SoC-процессора

- Через ОЗУ и флеш-память можно хранить резервные копии, допускается буферизация и временное хранение полученных данных.

- На завершающей стадии через сетевой интерфейс производится пакетная передача данных в локальную сеть (для IP-камер) либо потоковая передача данных (для HD-SDI или EX-SDI камер), либо видеосигнал из цифрового преобразуется обратно в аналоговый (для старых аналоговых CVBS камер либо новых HD-CVI, HD-TVI и AHD камер)

Производители

Тут, увы, примерно как с матрицами — если это не собственный процессор производителя камеры — то в Datasheet вы, скорее всего, информации о процессоре не увидите. Однако полезно знать хотя бы ключевых игроков.

Sony

В 1997 году корпорация SONY впервые применила цифровой процессор DSP (англ. Digital Signal Processor — процессор цифровой обработки сигнала) для обработки видеосигнала в системах охранного видеонаблюдения, что позволило значительно увеличить качество изображения. А в 2009 появился собственный процессор под торговой маркой «Effio». Аббревиатура «Effio» (Enhanced Features and Fine Image) Processor обозначает — «Процессор с Расширенными Возможностями и Прекрасным Изображением». Это позволило увеличить разрешение аналоговых CVBS видеокамер до 700 ТВл (разрешение свыше 582 ТВл. возможно только за счет цифровой обработки видеосигнала и до выхода Effio считалось не осуществимым).

Процессор первого поколения Effio-E поддерживает работу с ПЗС матрицами разрешения 960H, 760H и 510H и разрешение 700 ТВл, 600 ТВл. и 420 ТВл соответственно. Кроме того, обладает следующими возможностями:

- 2D шумоподавления (2D-NR);

- детектор движения;

- 8 приватных зон;

- компенсация высокой яркости — HLC (High Light Compensation);

- поддерживает функцию экранного меню (OSD).

Второе поколение — DSP Sony Effio-S — имеет DSP процессор и память видеообработки в одном корпусе, что позволяет реализовать помимо перечисленных выше функций:

- цифровое увеличение (E-Zoom);

- режим увеличение чувствительности (Sense-UP);

- 3D шумоподавление (вместо 2D, как в Effio-E).

DSP Sony Effio-P — уже третье поколение — также как и для второго — имеет DSP процессор и память видеообработки в одном корпусе. И дополнительный функционал:

- расширенный динамический диапазон — WDR (Wide Dynamic Range);

- цифровую стабилизацию изображения;

- 20 приватных зон.

Sony и сейчас продолжает выпускать процессоры для камер. Примером линейки новых процессоров от Sony является IPELA ENGINE EX. Но славу легендарных Effio они уже не затмили, на сцену выходили новые герои.

AXIS Communications

AXIS Communications — один из технологических лидеров в производстве IP камер видеонаблюдения. Сразу стали разрабатывать собственные процессоры ARTPEC — сейчас выпускается уже 7 поколение. Первое поколение вышло осенью 1999 года в камере AXIS 2100, которая была представлена на выставке Comdex в ноябре 1999 года.

«Наши чипы ARTPEC были маленькой революцией — для нас и нашей отрасли. Хотя мы, возможно, и не изобрели колесо, мы произвели революцию в способе передачи видео, добавив большую гибкость и возможности для новых приложений. Изобретение ARTPEC позволило нам разработать совершенно новые технологии, такие как Forensic Wide Dynamic Range (WDR), мощную аналитику и технологию сжатия данных Zipstream», — говорит Стефан Лундберг.

Благодаря специализированному оборудованию ARTPEC-1 для обработки изображений и сжатия, появилась возможность передавать потоковое видео прямо с камеры в удаленное место, используя Интернет, не используя без необходимости большое количество оборудования. ARTPEC-2, запущенный в 2003 году, увеличил производительность, но также начались эксперименты с более эффективным кодированием видео под названием MPEG. ARTPEC-3 был изобретен четыре года спустя. Впервые удалось установить видеокодер H.264 / AVC вместе с остальной частью системы в один SoC (система на кристалле).

В 2011 году был разработан ARTPEC-4, с помощью которого удалось решить проблемы ограниченного динамического диапазона и светочувствительности (технология Lightfinder). ARTPEC-4 впервые позволил создать камеру с прогрессивным сканированием (развёрткой).

С ARTPEC-4 также было разработано новое решение с широким динамическим диапазоном (WDR). Это решение продолжало улучшаться в 2013 году с ARTPEC-5 в функции Forensic Capture. Шестое поколение ARTPEC было выпущено в 2017 году. Добавив новый уровень безопасности, оно также проложило путь для последнего звена в семействе ARTPEC, которое было разработано только два года спустя: ARTPEC-7. Этот процессор позволил ещё улучшить показатели светочувствительности (технология Lightfinder 2.0) и динамический диапазон WDR.

Hanwha Techwin

Hanwha Techwin (ранее Samsung Techwin) занимается системами видеонаблюдения с 1991 года. На текущий момент последним из разработанных компанией процессоров для камер является WiseNet 5. Из интересной особенности — поддержка аппаратной функции WDR 150 дБ (обычно WDR «вытягивает» динамический диапазон 120дБ).

HiSilicon Technologies

HiSilicon является, фактически, подразделением Huawei. Процессоры этой компании используют даже такие мэтры, как Pelco и Honeywell. И тем более, их активно применяют китайские компании, например Hikvision. Так, например, HiSilicon выпускает чипсеты с поддержкой всех аналоговых HD стандартов — HD-TVI, HD-CVI и AHD, о чем поговорим ниже. Ещё любопытный факт о компании — она одной из первых стала выпускать процессоры с поддержкой нейросетей.

Сейчас у компании есть некоторые проблемы с продажами чипов в США из-за санкций, под которые попал сам Huawei.

Ambarella

Ambarella основана в 2004 году в США. Специализируется на разработке высококачественных SoC-процессорах, с низким энергопотреблением и эффективностью сжатия, способных создавать высококачественные изображения в условиях сложного освещения и интенсивного движения. Есть мнение, что процессоры Ambarella «жмут» поток при прочих равных на 1/3 лучше, чем аналогичные процессоры Hisilicon.

В январе 2022 года компания Ambarella анонсировала свой новый процессор обработки сигналов изображений с искусственным интеллектом. Эта технология на основе нейросетей “способна записывать видео 8K или четыре видеопотока 4K” и “улучшает цветовое представление и применяет HDR в условиях сверхнизкой освещенности”.

Techpoint

Techpoint была основана в 2012 году бывшим руководителем компании Techwell, крупного производителя полупроводников, в Сан-Хосе, Калифорния. На конец 2018 года Techpoint имеет офисы в США, Японии и Китае и производства в 5 странах (Япония, Китай, США, Корея и Тайвань). В 2013 году, после приобретения компании SDI Conexant, Techpoint вышла на рынок HD-телевизионных систем с устройствами HD-SDI, но технические особенности HD-SDI оказались бесперспективны для рынка видеонаблюдения. Поэтому в 2014 году они разработали формат HD-TVI, и начали производить чипсеты для него, которые используются в приемниках для видеорегистраторов и передатчиках для видеокамер.

Фактически единственным клиентом (по-крайней мере точно — ключевым) Techpoint является Hikvision.

NextChip

Nextchip — компания, известная как создатель аналогового стандарта высокой чёткости AHD. Сейчас AHD производит линейки ISP-процессоров (Image Signal Processing). Формат AHD появился в 2014 году, что сильно позднее других проприетарных форматов высокой четкости HD-TVI и HD-CVI. Nextchip не стали ни с кем партнериться, поэтому оборудование для видеонаблюдения начали производить тысячи небольших производителей, в основном из Азии. Чуть позднее и сами чипы AHD начали производить другие производители чипов, тот же Hanwha Techwin и HiSilicon. Можно упомянуть ещё Fullhan и Видимо Nextchip распространяют и саму технологию, а не только чипы собственного производства.

Характеристики

Производители процессоров — это конечно интересно, но мало что дает в практическом смысле. Чаще всего — мы выбираем производителя камеры и автоматом — производителя процессора этой камеры, мало где эти данные прописаны явно в Datasheet. Так что смотрим на другие вещи — ключевые характеристики и функционал процессоров.

FPS (frame per second, Frame rate, Frame frequency — «кадры в секунду», «кадровая частота») или скорость видеоввода

Это количество сменяемых кадров за единицу времени (сколько раз будет «считано» изображение с матрицы за секунду). Общепринятая единица измерения — кадры в секунду. Чем больше fps — тем более «плавным» будет видео. Но при этом увеличится битрейт (о котором ниже) — что может потребовать больших затрат на создание локальной сети передачи данных, а также на обработку потока сервером и архивирование записи.

Высокая скорость видеоввода равная 25 или 30 к/с обычно необходима на объектах, где требуется ситуационное видеонаблюдения в режиме «живого видео». Это могут быть места с большим скоплением людей и интенсивным движением, такие как вокзалы, аэропорты, крупные супермаркеты. Высокая FPS может потребоваться для распознавания автомобильных номеров на автотрассе (при скоростях движения авто до 150 — 250 км/ч). Также это может быть технологическое видеонаблюдение на каком-то сложном производстве, где важен каждый кадр технологического процесса.

Видеонаблюдение со скоростью 12 к/с может быть использовано в местах, где интенсивность движения средняя и присутствует небольшое количество двигающихся объектов. Например, офисные помещения, маленькие магазины и т.п. Как правило скорость отображения в 12 к/с вполне приемлема для наблюдения за движущимися объектами. И реальной необходимости в «живом видео» в данном случае нет.

Скорость в 6 к/с логично использовать на объектах, где сравнительно низкая интенсивность движения. Примеры таких объектов это: автостоянки, парковки, офисы. Также логично использовать скорость в 6 к/с при распознавании автомобильных номеров на парковке и въезде в парковку.

Отдельно следует рассмотреть FPS 60 к/с. Такая скорость видеоввода требует обоснования. Мне приходит в голову или технологическое наблюдение за быстрым процессом. Или работа в казино. Или фиксация государственных регистрационных номеров авто на высокой скорости — и то, это очень сомнительно. При FPS 60 к/с нужно уже внимательно смотреть на время экспозиции (оно может быть тупо больше 16 мс с которой сменяются кадры). А это приводит к снижению светочувствительности, что сильно повышает требования к уровню освещенности. Кроме того, не всякий процессор вытянет одновременно высокий FPS и высокое разрешение — иногда приходится выбирать. Ну и как правило о таких функциях, как WDR — с FPS 60 к/с приходится забыть — ведь при аппаратной реализации используется двойное сканирование матрицы с разной выдержкой.

Уровень видеосигнала (IRE)

IRE является единицей, используемой при измерении полных видеосигналов composite video. Его название происходит от инициалов Institute of Radio Engineers.

Значение 100 IRE в видеосигнале, первоначально определено, как диапазон активного видеосигнала (от черного до белого). Значение 0 IRE соответствует значению напряжения сигнала в течение периода обратного хода луча. Импульс синхронизации в PAL/SECAM — 43 IRE ниже этого значения 0 IRE, поэтому общий диапазон покрытия всего белого сигнала будет 143 IRE.

Значения IRE представляют собой относительное измерение (в процентах), так как видеосигнал может быть любой амплитудой.

| Чувствительность | illumination | Уровень |

|---|---|---|

| Полноформатное видео | Full video | 100 IRE |

| Полезное видео | Usable picture | 50 IRE |

| Мин. освещённость | Minimum Illumination | 30 IRE |

Как правило, IRE используется для обозначения условий измерений уровня чувствительности видеокамеры.

АРУ (Automatic gain control AGC)

Автоматическая регулировка усиления (АРУ или AGC) служит для поддержания максимального уровня видеосигнала на выходе камеры в пределах 0,7 В. Автоматическая регулировка усиления (АРУ) характеризуется глубиной АРУ и выражается в децибелах. Глубина АРУ у различных видеокамер может быть от 12 дБ до 30 дБ.

Чтобы можно было записать изображение при низкой освещенности, не изменяя при этом значение выдержки или глубину резкости, используется электронное усиление слабого сигнала датчика, и это позволяет получить более яркое изображение. Побочный эффект такого подхода заключается в том, что крошечные несовершенства картинки также усиливаются и воспроизводятся на изображении как помехи. Такие помехи ухудшают качество изображения и обычно приводят к увеличению трафика для передачи видеопотока.

Сигнал / шум (S/N Ratio, SIgnal/NoIse)

Отношение сигнал/шум (Signal-to-noise ratio SNR) — это отношение максимального уровня сигнала (уровень белого) к уровню шума матрицы и остальных электронных компонентов видеокамеры.

Отношение сигнал/шум характеризует «количество» шума, присутствующего в видеосигнале. Связано это с тем, что максимальный уровень сигнала в видеокамере имеет постоянную величину, поддерживаемую системой АРУ и имеющую значение 0,7 В, а собственные шумы могут иметь различные значения, в зависимости от используемой камеры. Чем больше отношение сигнал/шум, тем меньше шума присутствует в видеосигнале и тем лучше изображение на мониторе. Чем меньше формат матрицы, тем выше ее шумы и (следовательно) ниже чувствительность.

По рекомендациям CCIR (The International Radio Consultative Committee), существуют пять градаций качества в зависимости от отношения сигнал/шум.

| Градации качества | Отношение с/ш (дБ) |

|---|---|

| Отлично | Более 48 |

| Хорошо | 42 |

| Посредственно | 38 |

| Плохо | 34 |

| Очень плохо | Менее 30 |

Нормальным считается отношение сигнал/шум 45 дБ. У камер высокого класса это отношение достигает 58 дБ.

Чувствительность

Часто в Datasheet камер указывают параметр чувствительности, единицы измерения — Лк (люкс). Имеется в виду минимальная освещенность сцены, при которой камера ещё формирует контрастную сцену.

Использовать в проектных расчётах значения чувствительности камеры (люкс) можно, только если известны:

- Значения параметров камеры, при которых получается указанное значение:

- диафрагма (F) объектива, т.е. одинаковое раскрытие относительного отверстия объектива;

- время экспозиции, т.е. того времени, за которое матрица камеры будет формировать изображение, накапливая свет;

- коэффициент отражения сцены (сколько света отразится от объектов сцены и, соответственно, попадёт на матрицу)

Самое неприятное, что часто п.1-2, при которых проводят замеры освещенности — не совпадают с характеристиками камеры, для которой они указаны (часто F-число у камеры больше, чем при замере Лк)

- Параметры получаемого изображения:

- IRE видеосигнала, т.е. уровня сигнала при данной освещённости

- отношение сигнал/шум изображения при минимальной освещённости (согласно CEA 639 граничным значением при определении минимальной освещённости является отношение сигнал/шум = 17дБ (7 раз по напряжению))

Функции обработки

Пройдемся по стандартному функционалу, который обеспечивает современный процессор камеры. Производительность современных процессоров на столько высока, что с лихвой закрывает ключевые функции — забрать сигнал с матрицы, сжать его кодеком и передать в линию связи. Избыточную производительность «утилизируют» функциями обработки изображения, в том числе модными сегодня «видеоаналитическими» функциями «на борту камеры».

BLC, HLC, WDR

Перечисленные функции преследует цель обработать сигнал процессором камеры таким образом, чтобы «улучшить» изображение.

- BLC (Back Light Compensation) — функция помогает получить нормальную детализацию картинки в условиях засвеченного заднего фона. Когда объект находится на переднем плане, а на заднем — источник яркого света, то мы видим объект только в виде силуэта. BLC компенсирует встречную засветку путем выравнивания яркости изображения (фактически за счет экспонирования по части кадра, где располагается зона интереса Region of Interest — ROI), благодаря этой функции Вы сможете детально видеть темные объекты на фоне яркого света, например света фонаря, окна и т.д.

Что происходит:

— повышение уровня экспозиции для всего изображения

Плюсы:

— объект наблюдения становиться светлее и четче

Минусы:

— передержка в ярко освещенных участках, (яркие зоны становятся еще светлее)

- HLC (Highlight Compensation) — функция для компенсации яркой засветки. из расчета средней яркости изображения происходит маскировка источника яркого света, позволяя рассмотреть темные участки. Фактически происходит экспокоррекция (Exposure Compensation).

- WDR (Wide Dynamic Range – широкий динамический диапазон) – это технология, позволяющая получать высокое качество изображений при значительном перепаде уровней освещённости.

Показатель WDR измеряется в децибелах (дБ). Он рассчитывается как отношение светимостей самого яркого и самого тусклого объекта, которые были захвачены видеокамерой. Наиболее распространённый метод получения широкого динамического диапазона базируется на матрицах Double Scan или QuadroScan. Для каждого кадра матрица делает два или четыре сканирования с разной выдержкой электронного затвора и формирует предварительные изображения — одно с длинной выдержкой для осветления всех тёмных частей кадра, другое с короткой выдержкой с более корректным отображением переосвещённых участков. После этого фрагменты с лучшей передачей контраста суммируются в результирующий кадр, сбалансированный по яркости.

Очевидный недостаток WDR — длительное время экспозиции за счет нескольких сканирований матрицы, что может давать «смаз» от быстро движущихся целей наблюдения.

Как правило любые «улучшители» изображения требуется отключать при использовании алгоритмов видеоаналитики.

AIS, OIS, EIS

Перечисленные функции преследует цель обработать сигнал процессором камеры таким образом, чтобы «улучшить» изображение при вибрации камеры.

Стабилизация изображения на базе искусственного интеллекта (AIS)

Технология стабилизации изображения на базе искусственного интеллекта позволяет снимать фото или видео с длинной выдержкой, особенно при низком освещении, при этом изображение получается четким и детальным без размытия.

Оптическая стабилизация изображения (OIS)

Технология оптической стабилизации изображения обеспечивается работой специальных механизмов, которые стабилизируют процесс фотосъемки, определяя движение камеры и в соответствии с этим перемещая объектив.

Электронная стабилизация изображения (EIS)

Электронная стабилизация изображения осуществляется с помощью анализа изображения примерно 2/3 области в датчике изображения и последующего использования изображений по краям для компенсации движения камеры. Такая стабилизация используется в большинстве камер.

Lightfinder / Darkfighter / Starlight (серии камер ColorVu, AcuSense, WizSense)

Технологии, позволяющие получать цветные изображения при низкой освещенности сцены (камера не переходит в режим «ночь», не «откидывает» инфракрасный режекторный фильтр). Основной механизм работы — выбор светочувствительных крупных матриц, качественной оптики высокого разрешения и фирменных алгоритмов обработки изображения процессором камеры.

Видеоаналитика «на борту»

Сейчас мало кого удивишь встроенными модулями видеоаналитики «на борту» камеры видеонаблюдения. Даже бюджетные модели могут иметь стандартные аналитические функции:

- пересечение линии

- вторжение в зону

- антисаботажные функции (изменение фона)

- оставленные предметы

- громкий звук

- захват лица

- подсчет посетителей

- тепловая карта для определения мест с наибольшей и наименьшей активностью посетителей

Топовые процессоры камер позволяют решать куда более специфичные задачи анализа видео, даже такие «модные», как нейросетевые алгоритмы.

Примеры таких алгоритмов:

- классификация по категориям «человек», «транспорт» или «другое»

- определение количества людей в очереди и времени ожидания каждого человека

- распознавание лиц

- распознавание номеров авто

И в этой связи нельзя не упомянуть однокристальную систему HiSilicon Kirin 970, как один из первых чипов со специальным модулем поддержки нейронных сетей.

Сжатие и передача

Кроме обработки «сырой» картинки с матрицы — процессор должен ещё сжать полученные данные и передать их в линию связи (до видеорегистратора / коммутатора / сервера).

Кодеки

Одна из задач процессора — сжать полученные после обработки кадры — для уменьшения потока данных, передаваемых через сети связи на видеосервер или видеорегистратор. Для этого применяют стандартные кодеки. Кроме этого, у многих производителей есть дополнительные к кодекам технологии сжатия, основанные на области интереса в кадре (часть кадра является фоном, который не обязательно передавать в полном качестве).

Кодеки делятся на две основных категории:

- внутрикадровые (покадровые)

- межкадровые

Суть внутрикадровых кодеков сводится к сжатию отдельных кадров способ, аналогичным сжатию статичных картинок. Примером такого кодека является MJPEG (Motion JPEG). Фактически это последовательность изображений, сжатых стандартным кодеком JPEG.

Исторически первыми были именно внутрикадровые кодеки. Их главный недостаток — очень высокий поток, который формирует процессор, что затрудняет применение кодека для камер с матрицей высокого (мегапиксельного) разрешения. К достоинству можно отнести отсутствие проблем со «стоп кадром», характерных для межкадровых кодектов (о чем речь дальше).

Межкадровые кодеки основаны на идее передачи т.н. «опорных» кадров. Между опорными кадрами передается только информация о изменениях в кадре, но не весь кадр. Это существенно сокращает поток данных от камеры. Пример межкадровых кодеков — H.264 и H.265. Сейчас эти кодеки — наиболее распространенные.

Профили кодеков

H.264 и H.265 не совсем стандарт, а скорее набор рекомендаций для конкретной реализации кодеков. Профили кодеков определяют комплекты возможностей, ориентированные на конкретные классы приложений. Профили обеспечивают совместимость между устройствами, которые имеют разные возможности декодирования. Что касается профилей, кодер и декодер согласовывают набор функций, который они оба могут обрабатывать. Пример профилей:

- Baseline Profile (Базовый профиль)

- Main Profile (Основной профиль)

- High Profile (Высокий профиль)

Zipstream, WiseStream, H.264+, H.265+ и др.

Это дополнительные к стандартным кодекам H.264 и H.265 технологии сжатия, основанные на:

- динамическом выборе представляющих интерес областей Region of interest (ROI)

- динамической регулировке периода следования опорных кадров Group of Pictures (GOP)

- динамическом определении кадровой частоты frame per second (FPS)

Битрейт (bitrate) CBR / VBR

В работе процессора нам важны два факта — генерируемый им битрейт (для дальнейшего расчёта локальной сети, видеосерверов и систем хранения данных) и тип этого битрейта — постоянный или переменный (это влияет только на расчет локальной сети).

CBR (сокращение от «constant bit rate», в переводе — «постоянный поток данных») – означает, что камера выдаёт видеопоток одной и той же не зависящей от других параметров величины (по факту может колебаться в пределах ±10%). Эта величина определяется в настройках камеры. По умолчанию разные производители для различных линеек камер ограничивают поток для CBR в районе 2-х, 3-х, 4-х Мбит/с.

Очевидно, удобен CBR тем, что под него легко посчитать требуемое дисковое пространство и подобрать коммутаторы. Подвох в том, что 10 к/с со средним размером кадра в 100 КБайт и 25 к/с со средним размером 40 Кбайт в итоге дают один и тот же поток. Какой вариант больше устроит? Меньшая скорость с лучшим качеством или среднее качество «живого видео»?

Чтобы получить ответы, нужно обратить внимание на связанную с режимом CBR опцию задания пользователем приоритета (Priority). В итоге получим следующие сценарии работы:

- приоритет скорости (speed или rate)

- приоритет качества (quality)

- приоритет одинаков (none)

CBR можно рекомендовать, прежде всего, при необходимости уложиться в твёрдо заданную и при том невысокую пропускную способность линии связи (когда перегружать канал нельзя ни в коем случае). Нередко применяется при работе в общей сети заказчика.

VBR (означает «variable bit rate», в переводе — «переменный поток данных») – другой подход к формированию выходного потока. Работает так: в меню камеры задаётся конкретное значение качества изображения (степень сжатия), после чего поток генерируется «как есть», размером пропорционально сложности изображения. Хорошая освещённость, малое движение, неподвижная камера – и исходящий поток не превышает мегабит-другой. Если же ситуация начнёт меняться (пошли люди, поехали машины, замигали фонари или даже шум подрос из-за снижения освещённости) – видеопоток увеличится пропорционально, без «резки» скорости или качества.

VBR с ограничением «сверху» (особенно «продвинутые» его варианты типа Zipstream) — естественный выбор для задач наблюдения, не привязанных жёстко к пропускным способностям IP-каналов. Позволяет получить качественное изображение с заданным темпом, вне зависимости от условий эксплуатации.

Потоковая передача видео

Для аналогового видеонаблюдения все просто — мы или передаем весь генерируемый камерой поток данных, или нет. В IP все гораздо интереснее.

Мы разобрались с характеристиками битрейта — но при выборе процессора нас интересует сколько и каких битрейтов (потоков) процессор IP камеры может сгенерировать. Современные процессор IP-камеры, как правило, генерирует не менее 2 потоков:

- основной

- и дополнительный

Но потоков может быть и гораздо больше — и 3, и 4 потока. Для разных потоков могут быть установлены разные типы кодеков, настройки FPS и разрешения и многое другое.

Тип сетевого протокола

Как передавать поток данных через сеть — зависит от возможностей процессора камеры и выставленных настроек. Как правило используют:

- TCP — устанавливает соединение между отправителем и получателем, следит за тем, чтобы все данные дошли до адресата без изменений и в нужной последовательности, также регулирует скорость передачи

- UDP не устанавливает предварительного соединения, а вместо этого просто начинает передавать данные. UDP не следит чтобы данные были получены, и не дублирует их в случае потерь или ошибок

- MUC (Multicast) отправляет в сеть один единственный поток данных, который затем дублируется маршрутизатором или коммутатором с функцией маршрутизации мультикаст-трафика

Как правило, процессор камеры передает поток по UDP, TCP почти не используется, а вот Multicast вполне может встречаться, но наличие поддержки Multicast нужно проверять в характеристиках камеры.

Стандарты

Можно разделить стандарты передачи данных на две большие группы:

- цифровые

- аналоговые

К аналоговым относятся:

- т.н. «вещательный» стандарт CVBS (Color, Video, Blank, Sync) — это те самые старые стандарты PAL / NTSC, что можно встретить уже разве что в некоторых видеодомофонах

- т.н. «новый аналог» — проприетарные стандарты высокой четкости HD-CVI, HD-TVI и AHD.

К цифровым относятся:

- пакетная передача данных с применением стека протоколов TCP / IP

- потоковая передача по стандартам цифрового вещательного телевидения HD-SDI и логическое развитие HD-SDI/3G-SDI — проприетарный EX-SDI

На текущий момент ниша крупных систем видеонаблюдения, а также систем видеонаблюдения, интегрированных с другими слаботочными системами — занята IP видеонаблюдением. Роль «нового аналога» — HD-CVI, HD-TVI и AHD — небольшие бюджетные решения с ограниченным функционалом. Остальные стандарты занимают ничтожную долю рынка.

Управление и интеграция

Говоря о стандартах, нельзя не упомянуть способы «состыковать» оборудование разных брендов между собой (например IP камеру с видеосервером) — в плане передачи настроек потоков и управления устройствами. Есть несколько таких вариантов, по-сути стандартов:

- RTSP (Real Time Streaming Protocol)

RTSP — потоковый протокол реального времени, в котором описаны команды для управления видеопотоком. С помощью этих команд происходит трансляция видеопотока от источника к получателю. Например, от IP-камеры к видеорегистратору или серверу.

Что доступно при подключении по RTSP?

- Передача видеоданных.

- Прием и передача аудио данных.

Преимущество этого протокола передачи в том, что он не требует совместимости по версиям. На сегодняшний день RTSP поддерживают практически все IP-камеры и NVR.

Недостатки протокола в том, что кроме передачи видео- и аудиоданных больше ничего не доступно.

- ONVIF (Open Network Video Interface Forum — Форум открытого сетевого видеоинтерфейса)

ONVIF — это отраслевая международная организация, основанная Axis, Bosch и Sony в 2008 году, которые разработали API-спецификации (Application Programming Interface) для интеграции продуктов безопасности между собой и объединили их в «профили», содержащие конкретные наборы функций.

В основе спецификация ONVIF лежат стандарты web-сервиса. Web-сервис – это стандартизированный метод для интегрированных приложений, использующий независимые стандарты открытых платформ, таких как XML, SOAP, SOAP 1.2 и WSDL (WSDL 1.1) на базе IP сети. XML используется в качестве языка описания данных, SOAP применяется для передачи сообщений, а с помощью WSDL описываются непосредственно сервисы. SOAP является протоколом на основе XML сообщений и предназначен для кодирования информации в запросе web приложения и в ответе, прежде чем информация будет передана по сети. SOAP считается комплексным, но в то же время более сложным в использовании.

Что доступно при подключении по ONVIF?

- Обнаружение устройств.

- Передача видеоданных.

- Прием и передача аудио данных.

- Управление поворотными камерами (PTZ).

- Видеоаналитика (например обнаружение движения).

Эти параметры зависят от совместимости версий протокола ONVIF. В некоторых случаях часть параметров недоступна или работает некорректно. Смысл работы ONVIF в стандартизации базовых функций устройств видеонаблюдения, чтобы облегчить выбор конечному пользователю

- PSIA (Physical Security Interoperability Alliance — Альянс за совместимость систем физической безопасности)

В сентябре 2008 г. PSIA выпустил свою первую спецификацию. Буквально на несколько месяцев позже PSIA. Хотя битва между ONVIF и PSIA за стандартизацию сетевых камер продолжается, при ближайшем рассмотрении можно увидеть, что оба стандарта похожи. Оба предлагают общие требования к устройствам управления и контроля для совместимости разных продуктов. В каждой спецификации присутствуют механизмы и направляющие для поиска и управления устройствами, настройки сети, аналитики и PTZ-функциями, а также вещания видеопотока по HTTP/RTSP и безопасности.

PSIA использует архитектуру передачи состояния представления (representational state transfer, REST), которая является самым последним подходом, используемым сегодня практически во всех web-приложениях. REST проще в использовании по сравнению с SOAP и требует только простого XML-парсера с меньшей обработкой. Для архитектуры REST нужно меньше ресурсов, чем для SOAP. Еще одним преимуществом REST является возможность чтения сообщений протокола, которые легко интегрируются в систему отладки. Из-за высоких требований к вычислительным ресурсам и каналу передачи данных SOAP выглядит мене привлекательным для использования. Для SOAP нужны полностью совестимый HTTP-сервер, SSL и XML-парсер.

Например, для смены PTZ-позиции в ONVIF требуется SOAP-описание заголовка размером примерно 12 Кб. В PSIA же для изменения PTZ-позиции нужно всего лишь перейти по URL-адресу, что требует только нескольких байт.

Учитывая, что требования к сетевым камерам являются больше логическим стандартом, нежели физическим, не исключается вариант, что производитель применит к камере оба стандарта, или эти требования сольются в единое представление.

Заключение

Выбирая процессор камеры — нужно четко понимать место камеры в вашей системе видеонаблюдения. В каких условиях будет вестись съемка, нужна ли обработка видео для лучшего восприятия оператором для ситуационного наблюдения или будет применяться видеоаналитика, для которой любое вмешательство в изображение с матрицы — скорее вред? Нужен ли вам функционал аналитики камеры «на борту» или обработка будет идти на стороне сервера? Сколько потоков с камеры и для каких задач вы будете забирать? Умеет ли работать с такими потоками ваш софт? И как он будет управлять камерой — по API камеры (фактически с помощью драйвера в софте) или стандартными протоколами управления? И хватит ли вам функционала стандартных протоколов?

Очень много вопросов, о которых придется подумать — дать вам готовый рецепт я не готов. Но в блокнот можно записать:

На что влияет процессор IP-камеры?

- Число и характеристики потоков

- Функции обработки изображения с матрицы

- Видеоаналитика «на борту»

- Стандарты «управления» со сторонних устройств

Число и характеристики потоков

- Как правило, не менее 2 (основной и дополнительный)

- Максимальное разрешение и FPS

- Битрейт и тип (CBR / VBR)

- Кодеки и доп. сжатие

- Тип сетевого протокола (UDP, Multicast, редко TCP)

Функции обработки изображения

- АРУ (AGC)

- BLC, HLC, WDR

- AIS, OIS, EIS

- Lightfinder / Darkfighter / Starlight / ColorVu

Видеоаналитика «на борту»

- антисаботажные функции (изменение фона)

- пересечение линии / вторжение в зону

- оставленные предметы

- нейросетевая (классификация «человек», «транспорт», распознавание лиц, номеров)

Стандарты «управления» со сторонних устройств

- Onvif

- PSIA

- RTSP (только видео и звук)

- Что такое плотность пикселей?

- Аналитика «на борту» видеокамер

- Уход брендов и санкции: тренды рынка видеонаблюдения в 2023

- ГОСТы на проектирование «пожарки»

- Что такое авторский надзор?

Пишите ваши комментарии где что я напутал, забыл или неправильно указал, вступайте в Клуб проектировщиков Telegram и подписывайтесь на мои соц. сети — продолжим общение там. Спасибо за уделенное время!

Приходите учиться! Будем разбирать ключевые моменты — выбор камер, локальной сети, серверов и софта. Подробности — по ссылке в баннере: